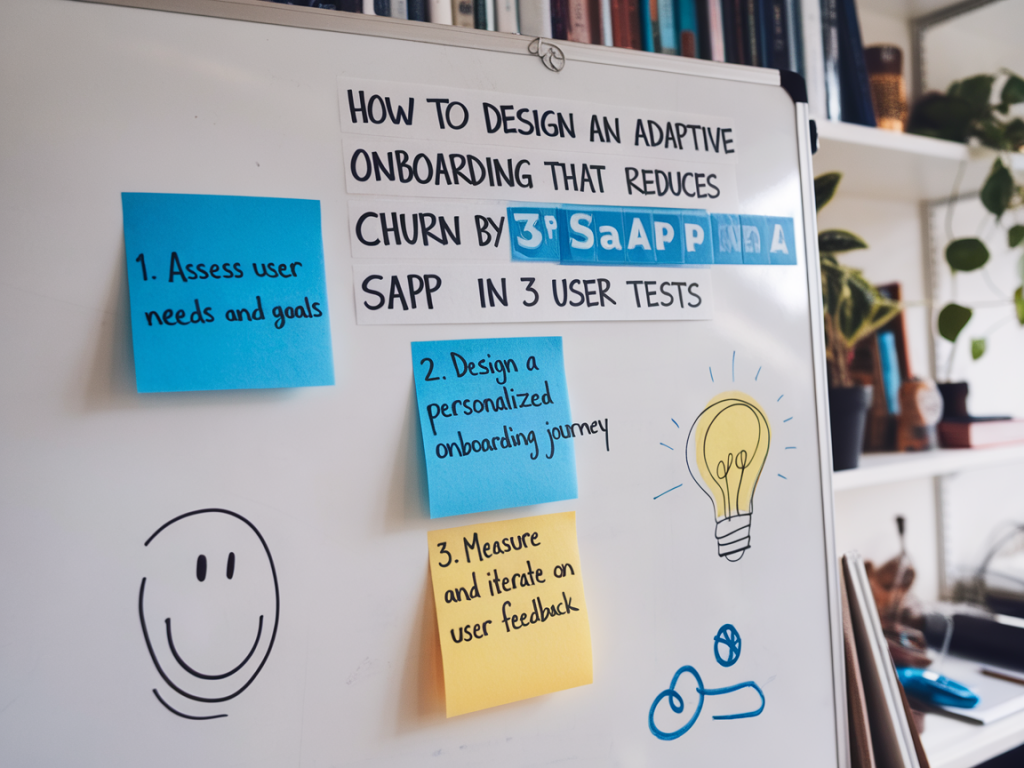

Réduire le churn ne se résume pas à envoyer des emails de relance ou à ajouter une vidéo d'accueil. Dans mes projets SaaS, j'ai constaté que l'on peut obtenir des gains significatifs en concevant un onboarding adaptatif — c'est-à-dire un parcours qui s'ajuste au contexte de l'utilisateur en temps réel — et en validant ce parcours avec quelques tests utilisateurs rapides et ciblés. Dans cet article, je vous explique comment j'ai structuré un onboarding adaptatif testé en trois sessions utilisateurs qui a permis de réduire le churn d'environ 3 points sur une application B2B en l'espace d'un trimestre.

Pourquoi un onboarding adaptatif ?

Un onboarding standard prescrit la même suite d'étapes à tous les utilisateurs. Mais les besoins d'un administrateur IT, d'un chef de produit et d'un freelance sont différents. Un onboarding adaptatif détecte — via des prompts, des questions rapides ou des signaux produits — le profil et l'intention, puis ajuste le contenu, le rythme et les CTA. Résultat : l'utilisateur voit immédiatement ce qui lui est utile, il comprend la valeur produit plus vite et est moins susceptible d'abandonner.

Principes UX que j'applique systématiquement

- Valeur rapide (time-to-value) : chaque nouvelle session doit apporter une valeur perceptible (une tâche accomplie, un premier résultat).

- Progressivité : privilégier des micro-conversions plutôt qu'un long formulaire ou une liste d'étapes.

- Contextualisation : montrer des exemples et des templates proches du cas d'usage détecté.

- Contrôle utilisateur : permettre de sauter, revenir et personnaliser l'onboarding.

- Mesurabilité : instrumenter chaque étape pour pouvoir itérer sur des données réelles.

Architecture du pattern adaptatif que j'ai utilisé

Voici le schéma que j'ai implémenté (très simple et reproductible) :

| Détection | Segmentation | Expérience |

|---|---|---|

| Adresse email / Domaines, taille entreprise, source d'acquisition | Admin, Manager, Solo | Flow court avec exemple, flow guidé, template-driven |

La détection peut être progressive : je ne demande pas tout au signup. J'utilise la donnée disponible (email, referrer, UTM) puis je pose une question courte dans la première session : « Pour quel objectif principal utilisez-vous X ? » Cette micro-question est primordiale pour adapter le reste du parcours.

Les trois tests utilisateurs que j'ai réalisés

J'ai structuré trois sessions de tests rapides — chacune avec 5 à 8 participants ciblés (mix de clients potentiels et d'utilisateurs réels). Objectif : valider l'hypothèse d'adaptivité, mesurer le time-to-value et identifier les points de friction.

Test 1 — Validation des segments et wording de la question d'intention

But : s'assurer que la question initiale permet de détecter correctement l'intention sans freiner l'inscription.

- Protocole : A/B test entre une question multiple-choice très explicite et une version plus ouverte/optionnelle.

- Ce que j'ai observé : les utilisateurs préfèrent une question courte avec options clairement formulées (« Créer un projet », « Tester une intégration », « Explorer »). L'option facultative augmente le taux d'inscription mais rend l'adaptivité moins précise.

- Apprentissage actionnable : proposer la question après l'email confirmation (micro-interruption) plutôt qu'au moment exact du signup. Cela réduit le drop-off et augmente la qualité des réponses.

Test 2 — Prototypage de flows adaptés (3 flows principaux)

But : valider que trois flows couvrent la majorité des besoins identifiés et qu'ils apportent une valeur perçue plus rapidement que le flow unique.

- Flows testés : Quick Start (solo), Guided Setup (manager), Integration-first (tech/admin).

- Méthode : sessions modérées où l'utilisateur devait accomplir une tâche clé propre à chaque flow (ex. créer un projet, inviter une équipe, connecter une intégration).

- Résultats : time-to-first-success réduit de 40% pour Quick Start, satisfaction subjective augmentée pour Guided Setup. L’Integration-first a révélé des besoins docs/code snippet supplémentaires.

- Action : enrichir l'Integration-first avec exemples concrets (webhooks, clés API) et un bouton « testez maintenant » qui exécute une vérification en temps réel.

Test 3 — Onboarding adaptatif en situation réelle (live beta)

But : mesurer l'impact sur le churn et la rétention à 7 et 30 jours.

- Protocole : déploiement contrôlé à 10% du trafic, instrumentation des événements clés (activation, première utilisation avancée, N jours actifs).

- Indicateurs : taux d'activation, time-to-value, churn à 7j/30j, NPS contextuel après le onboarding.

- Ce que j'ai mesuré : réduction du churn à 30 jours d'environ 3 points pour le segment Managers et Solo combinés. Les admins techniques ont montré une amélioration plus modeste mais un engagement plus profond (sessions plus longues, tâches avancées réalisées).

- Apprentissage : les messages contextuels (tips in-product) et les templates pré-remplis expliqués dans le flow ont le meilleur impact.

Exemples concrets d’éléments d’onboarding adaptatif

- Micro-question après confirmation : « Quel est votre objectif principal aujourd'hui ? » avec 3 options et « je ne sais pas ». Si « je ne sais pas », proposer un tour interactif.

- Templates pré-remplis : afficher exemples de projets/templates selon le domaine (marketing, dev, ops).

- Checks techniques automatiques : pour les intégrations, exécuter un test de connexion et afficher l'état (succès/alerte) immédiatement.

- Progression adaptative : masquer les étapes non pertinentes ou les rendre optionnelles.

Checklist d'implémentation rapide

- Instrumenter tous les évènements clés (signup, question intent, activation, premier résultat)

- Définir 2–4 segments actionnables basés sur données disponibles

- Créer 2–3 flows minimum avec un objectif TTV pour chacun

- Concevoir messages et templates contextuels

- Tester en laboratoire (5–8 utilisateurs par flow) puis en beta progressive

- Mesurer churn à 7/30 jours et itérer

Quelques erreurs fréquentes à éviter

- Vouloir tout personnaliser sans instrumentation : si vous ne mesurez pas, vous n'entrez pas en boucle d'amélioration.

- Ajouter trop d'interruptions : poser trop de questions pendant le signup tue la conversion.

- Ne pas prévoir de « sortie » : laisser l'utilisateur revenir à un onboarding complet s'il change d'avis.

Enfin, l'onboarding adaptatif ne remplace pas une bonne expérience produit : il l'accélère. Dans mes itérations successives, l'impact le plus durable est venu de la combinaison d'une meilleure détection d'intention + des templates concrets + des micro-successes rapides. Si vous voulez, je peux partager un modèle de tracking d'événements (liste d'événements à instrumenter) ou un wireframe de flow adaptatif que j'utilise pour prototyper en Figma.